Sebagian besar perbincangan mengenai ambisi AI di India berkisar pada pokok pembicaraan yang sama: model dasar, LLM, kurasi kumpulan data, dan AI yang bertanggung jawab. Namun ada masalah yang lebih sulit dan tidak terlalu menarik yang mematikan sebagian besar proyek AI sebelum diluncurkan: infrastruktur. Bukan jenis yang Anda berikan di dasbor, namun jenis yang menentukan apakah bukti konsep Anda akan menjadi produk yang benar-benar dapat digunakan siapa pun.

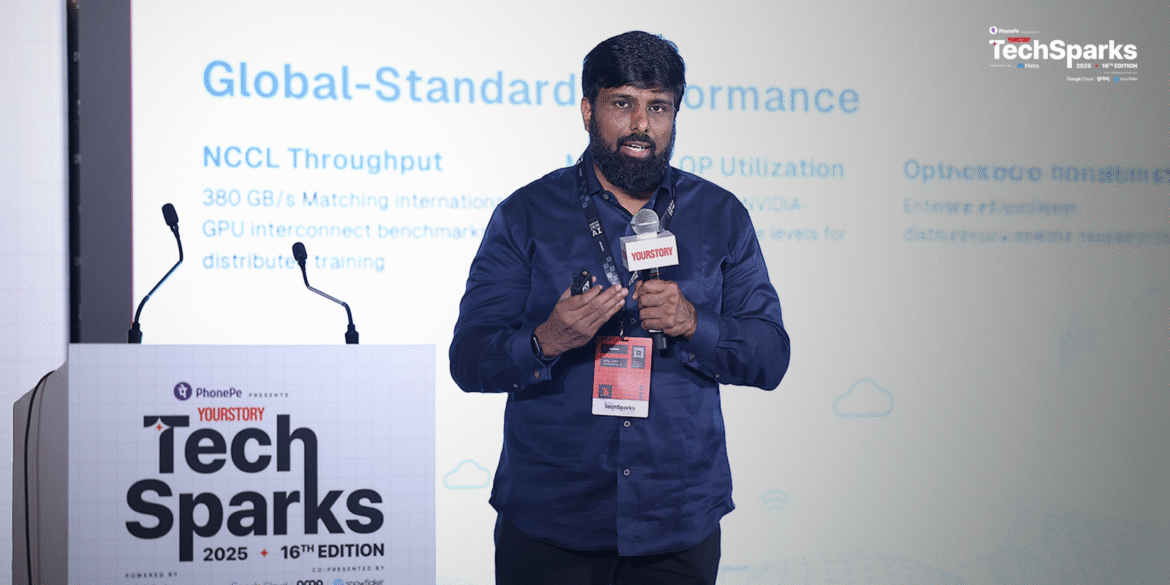

di TechSpark 2025, ceritamu peristiwa teknologi besar, Mohammad Imran K.RSalah satu pendiri dan CTO jaringan E2Emengambil panggung untuk memberikan ceramah tentang infrastruktur canggih (SOTA) untuk AI generatif, dan dia tidak menjelaskan apa saja yang rusak. “Meskipun ada banyak minat terhadap cara penerapan model AI generatif, cara pembuatannya, dan cara pelatihannya, kecuali Anda memiliki infrastruktur yang sangat baik, model tersebut tidak dapat diterapkan secara massal,” katanya.

Setelah menghabiskan 15 tahun di bidang infrastruktur cloud, diagnosis Imran sangat tajam. Perbedaan antara demo kerja dan penerapan skala populasi? Di sinilah sebagian besar startup AI di India mati. Bukan karena model mereka lemah, tapi karena infrastruktur di bawahnya tidak mampu menahan beban tersebut.

Mengapa infrastruktur menjadi penghalang nyata bagi skala AI

Inilah masalah yang kebanyakan orang lewatkan. Semua orang melihat arsitektur model, tetapi model tidak ada gunanya jika tidak dapat dilatih dengan cepat, diterapkan dalam skala besar, dan melayani jutaan pengguna secara bersamaan tanpa mengalami kegagalan. Infrastruktur sangat buruk. Inilah yang membedakan makalah penelitian dengan bisnis.

Perjalanan dari PoC ke pasar produk memerlukan penyesuaian dalam skala global yang disebut Imran sebagai infrastruktur SOTA—sistem canggih yang dapat menangani tuntutan brutal AI generatif tanpa menghabiskan anggaran atau waktu.

Ini bukan hanya tentang menyewa GPU. Ini tentang keseluruhan jaringan, jalur penyimpanan, tingkat pemanfaatan, lapisan keamanan, orkestrasi, dan banyak variabel lainnya yang, jika salah dikonfigurasi bahkan dengan margin sekecil apa pun, dapat mengubah pelatihan 12 hari menjadi lubang uang 20 hari.

Kesuksesan Jaringan E2E — Mengalahkan Tolok Ukur Global

Di sinilah hal menjadi menarik. E2E baru-baru ini menjalankan pengujian nikel – benchmark standar Nvidia yang digunakan untuk mengukur kinerja infrastruktur skala besar – pada sekelompok 1.024 GPU H100. Sasarannya adalah mencapai 400 gigabyte per detik, yang merupakan hal yang sangat sulit. Sebagian besar menganggap 360 GB/detik sebagai hasil yang kuat. E2E mencapai 380 GB/detik. Itu tidak bagus. Angka ini lebih baik dibandingkan standar yang dipublikasikan oleh penyedia infrastruktur secara global. Namun angka yang paling jelas adalah pemanfaatan model FLOP—metrik yang mengukur seberapa besar kapasitas komputasi GPU yang sebenarnya Anda gunakan versus seberapa banyak yang tidak digunakan.

Tingkat pemanfaatan terbaik Nvidia yang dipublikasikan? 53,4% dari E2E? 54%.

Ini mungkin tampak seperti perbedaan kecil, namun dalam dunia GPU, komputasi idle sangatlah mematikan. “Jika Anda berada pada tingkat 20,30% per bulan pada klaster yang sangat besar, Anda berpotensi kehilangan ribuan dolar setiap jamnya,” jelas Imran.

Dalam skala besar—misalnya 1.000 atau 2.000 cluster GPU—setiap poin persentase yang hilang dalam pemanfaatan berarti pemborosan finansial yang sangat besar. Perbedaan antara pemanfaatan 40% dan 54% bukan hanya performa. Kepraktisannya.

Dan tidak seperti era CPU, di mana pemanfaatan 10-20% dianggap normal, harga GPU jauh lebih mahal per unitnya. Anda tidak bisa membiarkan mereka bermalas-malasan. Infrastruktur E2E memastikan hal tersebut tidak terjadi.

Platform AI berkode rendah dan menyeluruh

E2E mengemas semua GPU, jaringan InfiniBand, sistem file paralel, orkestrasi, dan keamanan ke dalam platform kode rendah yang menangani pelatihan dan inferensi.

Meluncurkan cluster 1.024 GPU? menit Biasanya, infrastruktur membutuhkan waktu berhari-hari untuk dikonfigurasi dengan benar.

“Yang perlu Anda lakukan hanyalah login ke node login dan memulai aktivitas pelatihan Anda dengan cara yang sama,” jelas Imran. Platform ini mencakup penjadwal pekerjaan terdistribusi, dukungan untuk kerangka kerja seperti PyTorch Lightning, dan orkestrasi otomatis. Semuanya sudah siap.

Inferensi ditangani dengan kehati-hatian yang sama. Platform ini mengelola throughput token, time-to-first-token (TTFT), permintaan serentak, dan penskalaan otomatis, semua variabel yang menentukan apakah LLM dapat melayani pengguna sebenarnya atau gagal saat dimuat. Ini mendukung mesin inferensi modern dan dapat menskalakan ke chatGPT atau alternatif cloud menggunakan model terbuka seperti Llama Meta yang diterapkan pada skala perusahaan.

Yang terpenting, platform Imran menjembatani kesenjangan antara dua peran AI yang muncul: pembuat model dan penerapan model. “Ini adalah dua keahlian setara yang perlu Anda rekrut,” catatnya. Anda dapat memiliki arsitektur transformator terbaik di dunia, tetapi jika Anda tidak dapat mengimplementasikannya dalam skala besar, Anda tidak punya apa-apa. Platform E2E mengubah pembuat model menjadi penerapan model dengan menghilangkan kompleksitas infrastruktur.

Kedaulatan, Keamanan dan Misi AI India

E2E juga merupakan mitra dalam Misi AI India, yang menyediakan infrastruktur bagi beberapa pengembang model fondasi paling ambisius di negara tersebut yang dipilih oleh pemerintah.

Ini bukan sekadar kemitraan bisnis; Ini strategis. “Jika startup Anda melakukan sesuatu yang sensitif terhadap pemerintah atau hal lainnya, dan jika data Anda tidak berada di lokasi yang tepat, Anda mungkin berada dalam bahaya karena tidak memiliki kendali penuh atas data Anda,” kata Imran.

Untuk kasus penggunaan di pemerintahan, pertahanan, pendidikan, dan sektor sensitif lainnya, kedaulatan data bukanlah suatu pilihan. E2E menawarkan infrastruktur yang diatur oleh hukum India, dikelola oleh perusahaan India, dan secara fisik berlokasi di India. Tidak ada ketergantungan eksternal. Tidak ada kendali asing.

Platform ini juga mencakup fitur keamanan tingkat perusahaan — kontrol akses, autentikasi token, kemampuan rollback — karena dalam AI, kegagalan keamanan sangat merugikan.

Serangan DDoS pada situs web? Mengganggu Titik akhir yang belum terverifikasi dipenuhi dengan permintaan estimasi AI? “Anda dapat menaikkan suhu pusat data beberapa derajat,” Imran mencatat, karena server GPU membutuhkan banyak daya dalam skala besar. Dampak dari kurangnya keamanan pada infrastruktur AI tidak hanya bersifat finansial; Ini fungsional.

Optimalisasi perangkat lunak, efisiensi perangkat keras

Peningkatan kinerja E2E bukan hanya tentang mengatasi masalah perangkat keras. Mereka telah membangun kemitraan yang kuat dengan pemain perangkat keras dan perangkat lunak India, memanfaatkan SDK, operator, dan kerangka inferensi khusus dari Nvidia (seperti NIM) dan lainnya.

Hasilnya? Peningkatan kinerja yang signifikan dari perangkat keras yang sama melalui pengoptimalan tingkat perangkat lunak. “Anda bisa mendapatkan leverage yang signifikan dengan perangkat keras yang sama,” kata Imran. Pendekatan ini—efisiensi berbasis perangkat lunak—memungkinkan E2E memenuhi standar kinerja internasional tanpa perlu memperbarui perangkat keras canggih setiap triwulan.

Ini adalah platform kelas berdaulat, yang dikembangkan seluruhnya di India, dan memenuhi standar global. “Kinerja kami diukur secara global dan pada dasarnya semua standar internasional dalam hal kinerja untuk pelatihan, semua dilakukan di sini di India,” tutupnya.

Pembuat AI di India kini dapat membangun tanpa batas

Pentingnya di sini bukan hanya teknis. Itu terstruktur. Selama bertahun-tahun, perusahaan AI di India harus memilih antara membangun secara lokal dengan infrastruktur di bawah standar atau mengandalkan penyedia cloud asing dengan segala permasalahan kedaulatan, latensi, dan biaya.

Imran mengakhiri pidatonya dengan pemikiran sederhana. Efisiensi yang didorong oleh perangkat lunak adalah kunci nyata bagi masa depan AI di India. Dengan arsitektur yang tepat, saluran pipa yang dioptimalkan, kontrol akses yang aman, dan tumpukan berfitur lengkap, India dapat melatih, menerapkan, dan menskalakan model AI kelas dunia tanpa bergantung pada raksasa infrastruktur global.

Pesan di TechSparks 2025 jelas. Para pembuat AI di India tidak perlu menunggu infrastruktur global untuk mengejar ketertinggalannya. Masa depan infrastruktur AI yang berperforma tinggi, mudah diakses, dan berdaulat telah dibangun di sini.